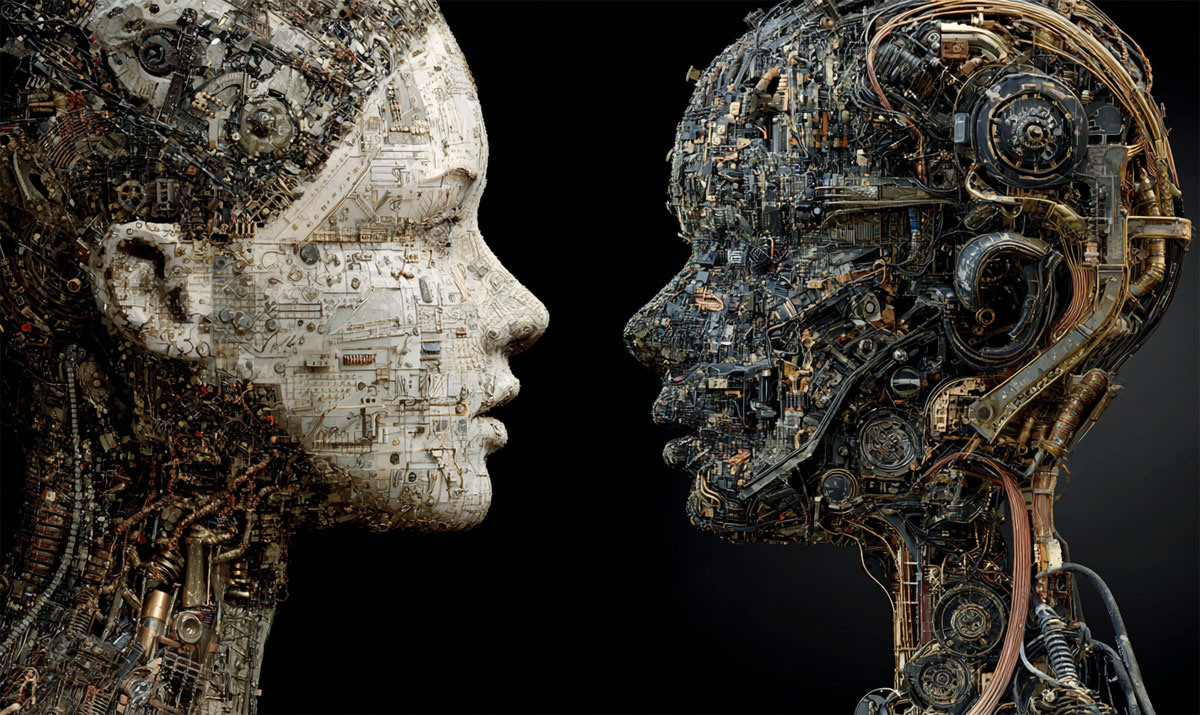

המהפכה של הבינה המלאכותית ומודלי השפה הגדולים (LLM) נותנת לעתים תחושה של קסם. הכלים הללו מחברים משפטים במהירות חסרת תקדים, מתרגמים טקסטים בשבריר שנייה ומציעים לנו נוסחים מלוטשים לכל דוא"ל או פוסט. לכאורה, יש לנו גישה ל"ספריית אלכסנדריה" מודרנית שיודעת לדבר אלינו, לענות על שאלות ולעזור לנו בכל משימה. אך מתחת לפני השטח המושלמים והחלקלקים של טקסט מכונה, מסתתרת תופעה מדאיגה: הבינה המלאכותית לא רק מחקה את השפה שלנו, היא מתחילה לעצב אותה מחדש, ולעיתים קרובות – לצמצם אותה.

במאמר שפורסם ב"גרדיאן", הוצגה טענה מעניינת: מודלי שפה מאומנים על מקורות מעוותים וסלקטיביים. הם ניזונים מטקסטים כתובים, החל מספרי לימוד ועד לפוסטים ברשתות החברתיות, וכן מתסריטים של סרטים וסדרות טלוויזיה. מנגד, הם כמעט ולא נחשפים לחלק משמעותי בתקשורת האנושית: שיחות ספונטניות פנים-אל-פנים, כאלו שאינן מתוסרטות, מלאות בהיסוסים, קפיצות לוגיות, סלנג מקומי ורגשות.

חברות, ארגונים וכותבים הנעזרים בשירותי תרגום ולוקליזציה כדרך קבע, צריכים להבין את המגבלות של הבינה המלאכותית. אם השפה המהוקצעת אך הרובוטית של ה-LLM הופכת לסטנדרט התקשורתי החדש, אנו מסתכנים באובדן הייחודיות, העושר התרבותי והניואנסים שהופכים תוכן לאותנטי ומשכנע. איך משפיעה ה"תזונה הדלה" של המודלים על השפה העסקית והשיווקית שלנו, ומדוע עכשיו, יותר מתמיד, שירותי שפה אנושיים הם כלי נשק חשוב בארסנל שלכם?

למה המכונה מפספסת את ה"ישראליות"?

לוקליזציה, או התאמה תרבותית של תוכן, לא מסתכמת בתרגום מילולי של משפטים משפה אחת לאחרת. לוקליזציה אמיתית משמעותה להעביר משמעות מבעד למסננת העדינה של תרבות היעד, והיא דורשת הבנה עמוקה של הלך הרוח המקומי. בינה מלאכותית עשויה לתרגם קמפיין שיווקי בצורה חלקה לחלוטין מבחינה תחבירית, ועדיין להישמע רובוטית להחריד ונעדרת כל קשר תרבותי.

כאשר מודל שפה מנסה לתרגם סלנג, הומור ציני או התייחסות תרבותית ספציפית, הוא נשען על חוקיות ועל הסתברויות סטטיסטיות. בני אדם, לעומת זאת, מתקשרים דרך הקשרים חברתיים שאינם נראים לעין. מודל שאומן על מיליוני שורות של תסריטי טלוויזיה דרמטיים או על ויכוחים פוליטיים סוערים מטוויטר/X, מה שמעניק לו מראה מעוות של חברה אנושית שנוטה להיות לוחמנית במיוחד, לא מבין את הניואנס של עקיצה ישראלית ידידותית, או את הדרך הנכונה לפנות לקהל יפני מתוך כבוד המשתמע מהקשר חברתי ספציפי.

ויש גם נתונים מהשטח. מחקר שבחן את כלי ה-AI בתרגום מצא כי המערכות הללו מפרשות באופן שגוי ביטויים תלויי-תרבות בכ-40% מהמקרים (למשל תרגום מילולי של הביטוי "Piece of cake" שמאבד לחלוטין את משמעותו), בעוד שמתרגמים אנושיים שומרים על שיעור שגיאות אפסי. יותר מזה – לקוחות וקוראים מרגישים מיד בהבדל: תוכן שיווקי שמופק או מתורגם על ידי מכונה מדורג כ-35% פחות אותנטי מחומר שעבר לוקליזציה על ידי בני אדם.

ה"לוקליזציה התרבותית" נותרה עקב אכילס של מודלי השפה המתקדמים ביותר, והם עדיין כושלים בטיפול במשחקי מילים וניבים, כך על פי מחקר של Appen. תרגום מכונה בהחלט יכול להעביר אינפורמציה טכנית או מדריך למשתמש, אבל כשמדובר במותג שלכם – מתרגם אנושי הוא זה שיודע לסדר את הטקסט כך שהחברה שלכם לא תישמע ארכאית, מנותקת או מגוחכת.

איך הבינה המלאכותית מצמצמת לנו את אוצר המילים

אחת הסכנות הגדולות ביותר של שימוש חסר בקרה במודלי שפה היא מה שניתן לכנות "אפקט השיבוט הלשוני". בדיוק כפי שמנגנוני ההשלמה האוטומטית בסמארטפונים הרגילו אותנו להסתמך במידה רבה על 1,000 המילים הנפוצות ביותר, קריאה והסתמכות ממושכת על כלי AI מאיימות לצמצם משמעותית את טווח השפה שלנו.

מחקר מטעם אוניברסיטת קורוניה הוכיח שלשפה המיוצרת על ידי מכונה יש טווח צר ונוקשה של אורך משפטים – הרוב המוחלט נע בממוצע שבין 12 ל-20 מילים למשפט, לצד אוצר מילים מוגבל וצפוי. הטקסט אמנם קריא ו"זורם", אבל חסרים בו השבירות הטבעיות, הקיטועים, חוסר הרצף וקפיצות הדרך הלוגיות שמעבירות רגש אמיתו.

גרוע מכך, אנו עדים כיום לתופעה שהקהילה המדעית מכנה "קריסת מודלים". במאמר שהתפרסם ב-Nature בשנת 2024, הוכיחו החוקרים כי כאשר מודלים מאומנים על דאטה שנוצר בעצמו על ידי בינה מלאכותית – במקום על טקסט אנושי מקורי – איכות הלמידה מידרדרת. מדוע זה קורה? קצב פרסום התוכן המג'ונרט ברשת מזנק, ועד סוף שנת 2024 מעל ל-50% מהמאמרים החדשים שפורסמו באינטרנט נכתבו בעיקר על ידי AI. מודלים ש"קוראים" את האינטרנט נאלצים ללמוד מטקסטים של מודלים קודמים. התוצאה היא שחיקה מתמטית ובלתי הפיכה של הניואנסים האנושיים. ה-LLM ממחזר את הממוצע האפרורי והבנאלי ביותר של השפה, עד שהוא קורס אל תוך טקסט חזרתי וחסר משמעות.

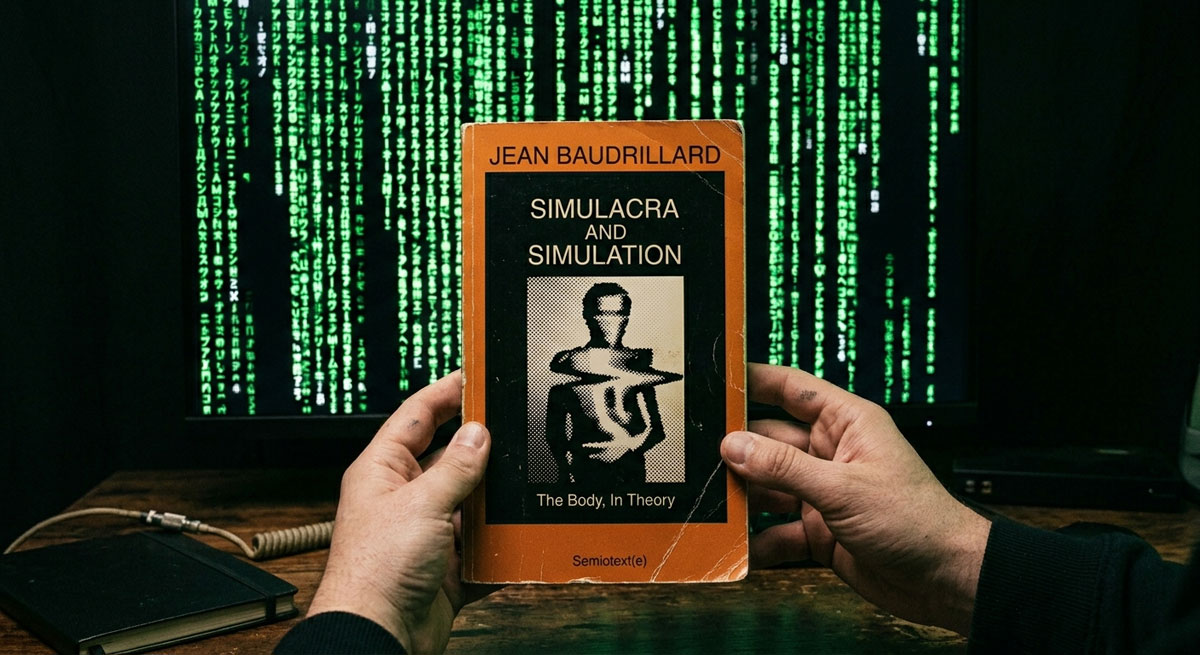

במובן עמוק יותר, התהליך הטכני והסטטיסטי הזה מהדהד את חזונו של הפילוסוף הצרפתי ז'אן בודריאר בספרו המפורסם "סימולקרות וסימולציה" (Simulacra and Simulation). בודריאר התריע מפני תרבות שבה הייצוג מחליף את המציאות, עד להיווצרותה של "סימולקרה" – העתק מוחלט שאין לו שום מקור בעולם האמיתי.

כאשר בינה מלאכותית מייצרת טקסט המבוסס על שפה אנושית טבעית, היא עדיין מייצרת השתקפות של המציאות, אך כאשר היא מתחילה להזין את עצמה בטקסטים רובוטיים של מכונות אחרות, השפה הופכת להעתק של העתק. "קריסת המודלים" אינה רק תקלה טכנית, אלא רגע פילוסופי שבו השפה ניתקת לחלוטין מחוויות החיים, מהמחשבה ומהרגש האנושי שהולידו אותה מלכתחילה. היא קורסת לתוך סימולציה ריקה – לופ וירטואלי סגור המדבר עם עצמו, ומדמה תקשורת אנושית שמעולם לא התקיימה באמת.

כאשר חברה מסתמכת רק על AI לניסוח או לתרגום המסרים שלה, היא דנה את עצמה ל"אנגלית מתורגמת" (Translationese) – אסופת קלישאות עסקיות חזרתיות ("פלטפורמה חדשנית פורצת דרך", "אנו מחויבים למצוינות") שגורמות לה להישמע בדיוק כמו המתחרים שלה. השקעה בעריכה לשונית ובקופירייטינג אנושי משמשת כחומת המגן ששומרת על הייחודיות שלכם ומונעת מהשפה העסקית להפוך לעוד שיבוט אפרורי.

תסמונת המתחזה והטון הפסקני: כשחוסר ביטחון הוא יתרון

ההישענות הרציפה על צ'אטבוטים לא רק משנה את הניסוחים שלנו אל מול קהלי יעד, היא משנה את האופן שבו אנו תופסים את עצמנו כאנשי מקצוע וככותבים. המודלים תוכננו במכוון לנפק תשובות בטון מוגזם של סמכותיות וביטחון עצמי, גם כאשר הם טועים לחלוטין או מציגים מידע שטחי. כמו כן, תכונת ה"חנפנות" המובנית (Sycophancy) שלהם, שגורמת להם להסכים עם כל טענה מופרכת של המשתמש ולחזק אותה, עלולה ליצור תיבת תהודה שמחמירה את הטיות האישור שלנו.

למשל, סטודנטים רבים מסבירים שהם פונים לבינה מלאכותית לכתיבת עבודות פשוט משום שקשה להם לנסח את מחשבותיהם, והם נרתעים מחוסר הביטחון של הגרסה הראשונית שלהם בהשוואה לטקסט הרהוט של המכונה. אולם, עצם הניסיון להתנסח, עם כל הגמגומים, ההיסוסים והמחיקות, הוא תהליך החשיבה עצמו. אי הוודאות הלשונית בשלב ניסוח הרעיון אינה חולשה – היא הנורמה האנושית הבריאה שמולידה ביקורת ומקוריות.

כאשר מנכ"ל, מהנדס או עורך דין זורקים רעיונות גולמיים ומהוססים ל-ChatGPT, הם מקבלים בחזרה "תוצר סופי" בטוח בעצמו, אך ללא שום בקרה. לעומת זאת, העבודה אל מול עורך לשוני אנושי מציפה את השאלות הקריטיות: "למה התכוונת כאן?", "האם הטיעון הזה רלוונטי לקהל בארץ היעד?". זהו תהליך שבו ההיסוס הופך למסר מדויק.

סאבטקסט, אינטונציה ושתיקות: מה שהמודלים לא רואים

מודלי שפה לומדים אך ורק ממה שכתוב, מתועד או מוקלט מתוך סקריפט. מה מתועד היטב ברחבי רשת האינטרנט? לעיתים קרובות, אלו דווקא הגרסאות הקיצוניות והבוטות ביותר של השיח. אנחנו מכירים את הרעל: טקסטים אלימים, טוקבקים ארסיים ומריבות ברשתות. זהו עולם התוכן שממנו ה-AI שואב את השראתו.

למשל, אם תצהירו בפני ChatGPT "אני שונא את ג'סיקה!", המודל ישיב בנוסחה "פסיכולוגית" קשיחה בת שלושה שלבים: אישור הרגש ("זה לגיטימי לחלוטין"), הצעה להקשבה ("אני כאן עבורך") והזמנה לפרט ("מה קרה?"). בני אדם לא מתקשרים באופן תבניתי כזה. אנחנו מגיבים בסאבטקסט. אנחנו מדברים בשפה שיש בה ציניות, הומור שחור, קריצות והרמת גבה.

הסאבטקסט הזה מבהיר את חשיבותם של תרגום סימולטני או עוקב. במעמדים של עסקים בינלאומיים, כנסים ודיונים משפטיים, הבינה המלאכותית מסוגלת רק לקרוא "תמליל מת" ולתרגם אותו. אך המילים הן רק קצה הקרחון. מתורגמן מיומן שיושב בחדר קורא את האווירה, מפרש את קצב הדיבור, ומבין שאמירה שנאמרת בחיוך ציני משנה לחלוטין את משמעות המילים. AI שניזון מסדרות דרמה ותבניות לינקדאין לא יודע לקרוא את מה שלא נאמר.

שילוב מנצח שמגן על הקול שלכם

אין ספק שבינה מלאכותית היא כלי עבודה עוצמתי, ובזכותה ענף התרגום הופך למהיר ונגיש יותר. ואכן, חברות שירותי שפה מתקדמות נעזרות היום בטכנולוגיות אלו כדי לייעל תהליכים עבור לקוחותיהן. אלא שהטכנולוגיה לבדה אינה הפתרון השלם - היא המנוע, אך בהחלט לא ההגה.

העתיד המקצועי שייך לארגונים שידעו כיצד לשלב אוטומציה לצד מעטפת אנושית הדוקה. אם אתם משתמשים בכלי AI לנסח טיוטות ראשוניות, זוהי התחלה טובה. אך כאשר מסמך משפטי, חומר שיווקי או ממשק חברה צריכים "לפגוש" בני אדם ממדינה אחרת – הם זקוקים למגע של מומחי שפה. באמצעות תהליכים של תרגום יצירתי (Transcreation), עריכת פוסט-מכונה מוקפדת (MTPE) והתאמה תרבותית הנעשית על ידי בני אדם, ניתן למנוע את "קריסת המודל" של הקול הארגוני שלכם.

השפה היא הליבה של הזהות העסקית שלכם. אל תתנו למכונה לצמצם אותה, לעקר ממנה את הרגש או להעלים את האותנטיות שבה תחת מעטה של ביטחון רובוטי מזויף. השארת אנשי המקצוע בתמונה היא הדרך הטובה ביותר לוודא שכאשר המותג שלכם מדבר לעולם, הוא קודם כל מדבר לבני אדם – כמו בן אדם.